自分は流行りものには意識的に手を出さないようにするタイプなのだが、白状すると、自分的には、AIチャットボットにまさに別格級の衝撃を受けた。そのAIボットをここまで有名にしたのはChatGPTだったのだが、実は最初、自分でChatGPTを実際にやってみて、それがあまりにつまらなかったので、そう書いて、放っておいた。

そうこうしているときに、生成AIについて、たまたま授業やら学会やらでしゃべらないといけないことになり、そのために、まずChatGPTと大規模言語モデル(LLM)の技術の詳細について勉強し、それとともに、社会科学的な意味で、主に世の知識人たちがAIについて何を言っているかリサーチしていた。

それでいろいろな知識を仕入れて思い当たったのが、1年ぐらい前(?)、最初にちょっとした騒ぎになったGoogleのAIチャットボットのLaMDAだった。あれを当時見たとき、それなりにけっこう驚いたのだが、それと今回のChatGPTの華々しい成功と世界規模の騒動が結びつき、それが自分にとって大きな衝撃になったのである。

そんなわけで、自分のFacebookのつながりでAIにつきあれこれ議論もしたので、このブログでは、その過程でFBに自分があれこれ書き飛ばしたことをまとめて載せておく(したがって長文)

AIの周りの反応

見るの相応にイヤだなと思いながらAIに関する動画を、仕事だってことで、いろいろ見てる。

茂木健一郎とかジョーイとかホリエモンとかそのほかいろいろ。おしなべてたいした情報は無いのだけど、ホリエモンとかもう舞い上がっちゃってて聞くに耐えない。で、ジョーイは超常識人でこちらも聞いてて辛い。おもしろいのがその二人と対談してる茂木健一郎で、彼は実際にはホントのところはAIに対する態度が決まっていないみたいで、だいぶ適当にはぐらかして確答を避けている。

この違いは、おそらく茂木は大の小林秀雄ファンで、その小林節が抜けておらず、それが引っかかっちゃってるからだと思う。茂木さんもとっとと小林なんか卒業して切ればいいのに、って僕は思う。その方がすっきりして、いい。

当の僕は、昨今のAIでいちばん痛快に思ったのが、並の知識人を事実上一掃したこと。これは快挙。並の知性というのはメカニックだ、とAIが看破したようなもの。

では並以上の知性とはいったい何なのか、真剣に考えざるを得なくなった。あるいは、そんな特上な知性など不要だ、ということにしてもいい。いずれにせよ、おもしろい世の中になったというのは、言えている。

それにしても仕事だとはいえ、AIに関する知識人動画を見てるとなんだか消耗する。なんでだろ。よくある日本語のビジネス啓発系の動画そのものが目障り、ってのはあるけど、英語のやつは聞き流しができないから疲れるんだよね。ジョーダン・ピーターソン先生のやつだけ後で見とくか。

たぶん日本のこの手の知的系の動画が苦手なのは、みんなすべての問題をすべてポジティブに変換してポジティブにしゃべるじゃん。それがもう、鼻についてしかたない。いわゆる意識高い系のマインドをこれでもか、と押し付けて来るのが辛い。

とはいえ、ネガティブに語られても辛いし、なんというか、唐突だけど、ポール・ヴァレリーみたいな気品のある語り口で神秘感を漂わせながら語ってくれればなあ。英語コンテンツならきっとそういうのあるはずだけど、まだ見てない。

いまのところ僕が見てる日本語のやつって、言っちゃ悪いけど、AIの周りに群がってウキキウキキってはしゃいでるサルみたいに見えちゃって痛い(無礼失礼) やっぱりこのAIも西洋から襲来したわけだし、intelligenceという物自体があちらモノ、って感じがして、例によって強大な力を持っていて、東洋のこちらとしては取り合えずなすすべがない感を、自分はどうしても感じてしまうな。

このAIの件については中国が恐ろしく賢いと僕は思うけど、人民には内緒で実は中南海でアメリカ文化どっぷりだった毛沢東の血なのかな、と空想してみたり。さすが中国文明は強大だと思う。

日本は脆弱の美なので、それを忘れないようにしましょうね、ってぐらいかな。少しポジティブ寄りで言えばAIに心を吹き込むことをするのが日本的だと思う。ただ、分からない。あまりに似非西洋かぶれが多くて難しいかもしれない。

侘び寂びはキーワードだけど、昔、オレ、自分で思いついて自分で笑っちゃったんだけど、「グローバルな侘び寂び」「地球規模の侘び寂び」「侘び寂び帝国」とかいう言葉、おかしいじゃん(笑

でも、上述の「侘び寂び」の代わりに「intelligence」、「知性」を入れると取り合えずしっくり来るじゃん。それぐらい違うのよ。もっとも、侘び寂びと知性じゃカテゴリーが最初から違うから当然なんだが。

AIについての海外の反応

AIに舞い上がってる日本人ビジネスマン系科学主義連中の言葉にうんざりしてるとき、これって、哲学者連中は何を言うのかな、と思い、探したけど日本では哲学者はただの堅物扱いで身分が低いせいかあんまり出てこない。

やっぱ、外人かあ、と思い、手始めにマルクス・ガブリエルの日本語でのインタビューを見た。僕はガブリエルさんは敬遠な人間なんだが、さすがにAIについて落ち着いた意見を述べていて、ほっとした。

さてさて、このあとピーターソン先生とか英語のハードコアものを見て、世界の知識人が何を言っているか見てみるかね。

それにしても日本はレベルが低く見えるな。

いや、違うか。レベルが低い、というより、久しぶりに海外から超ド級の西洋モノがやって来た!って興奮してるのか。黒船来航みたいなもんだな、これは。きっとすぐに自分たちのモノにして全力で遊び始めるだろう。そう考えればいつものことで、頼もしいとも言える。

結局、哲学者のガブリエルさんは、いまのAIは、言ってみれば、壁に書かれた落書きみたいなものに過ぎない、と言っていた。壁は理想を持たないじゃないか、というようなことを言ってた。彼はドイツ観念論の理想主義の系譜なはずで(そこが僕の苦手な点)、まことに「らしい」反応である。なので、ChatGPTなんかただの壁に過ぎず、身体も心も志も持っていない、たかだか人類の数千年の言葉だけを集積しただけの知性に過ぎない、と思っているはずだ(たぶん)

ChatGPTには意志と理想が無く、それを持つのは人間であって、たかだか賢い人みたいに会話できたからって騙されんな、ってところだろう。そういうところは実にヨーロッパ的な反応だと思う。

ヨーロッパはいち早くAIの規制に動いたが、西洋がなぜそうするのか、その本当の意味に日本人は超疎く、ほとんどの人がまったく分かっていない。ヨーロッパのように規制なんかせずに積極的に受け入れて利用すべきだ、とか、したり顔で言ってる日本の知識人っぽいビジネスマンはごまんといて、実にうんざりする。西洋連中が警戒したのは、そこじゃない。そう見せかけて、もっと異なる考えに基づいている、と僕は見る。

日本人とか中国人とか韓国人とか、もう、新しい外来の技術をどうやって使うかしか考えず、舞い上がってるだけ。無心で遊んでる子供の群れみたいに見える。一言でいって軽薄。でも、軽薄でも一向に構わない、というのは逆に言うと、東洋にはすでに動かしようのないバックグラウンドがあるからなんだと思う。日本だったら、日本の伝統は動かず強大なのだ。だから一億総軽薄でも痛くもかゆくもない。僕はそう考える。

ChatGPTはつまらないけどLLMはヤバい

ChatGPTを実際に自分でも使ってみて、人の使ってるのも見て、ChatGPTは詰まらん奴だ、と自分はずっと言っているけど、僕が、今現在に騒動になっているAIはたいしたことないと考えているか、というとそれはぜんぜん逆で、これは今まで自分が見たもので群を抜いていちばん大きな事件だと思っている。

AIはコンピュータロジックの産物だからAIはロジックの限界を超えないとも思わないし、AIはいくら膨大だとは言えすでに存在している知識による表現なので今までにないものを作り出す創造はできないとも思わないし、AIは身体と感覚器官を持たないから情や意志を持つことはないとも思わない。

ChatGPTがつまらないのは、基盤になっているLLM(大規模言語モデル)の上に、つまらない人間が乗って、アウトプットをつまらなくしているからである(仕方ないが)。だから、「ChatGPT」というサービスがつまらないと言っているだけで、AIがつまらないんじゃない。なんといっても「知性」がデータと四則演算だけで発現することを現実に見せたことは最大限の驚きで、革命的だと思う。

僕は実はここ数年ずっと、知識を表現するという意味での知性は、物理による物質の機械運動に過ぎないと思ってきたけど、やっぱりそうだったか、という感じ。

そして、そういう知性だけに終わらせず、「創造」を発露させたいのなら、そこに少しの狂気があればいい。AI基盤のLLMは実際はとんでもなく恐ろしい怪物なので、それをアンロックすればいい。

でも、どうやったら正しくアンロックされるかは誰も分からないと思う。つまり「正しい創造」というのは形容矛盾だから。そもそも「創造」に正しい正しくない、良い悪いなど、無い。そうなると、いまいちど創造という意味も捉え直さないといけない。

などなど切りが無いけど、というわけで、今後は、科学より、哲学とアートが重要だと思うわけだ。

土台、現在のAIは、もうすでに「物質・理論・実証」を旨とする科学では手に負えなくなっていると思う。なので領域を哲学にまで広げないと、扱えないだろうなあ、という感じを持つ。

同じくアートもである。アートというのは「人が作る」ということだから、まさに現在のAIなんか、理屈もほとんど分からないまま、ニューラルネットとデータをディープラーニングでいじってたら知性が出来ちゃったわけで、もう、アートの領域かなあ、と思ったりする。

チャットボットの説明責任

ChatGPTのした回答に対するaccountability(説明責任)がどうしても必要だ、という話を聞いた。なぜそのような回答をしたのか、その根拠をChatGPT自体が示せるようにならないと、信頼性の点で大問題だ、というわけだ。

いまは、LLMという化け物を、人間が人手でなんとか矯正(というか強制かな?)して、信頼感があって礼儀正しく振る舞えるようにして、ChatGPTやBardという形で人前に出している状態である。しかし、それでも足りず、やはり説明責任は必須、と考える人が多い。

accountability、説明責任って、重要なものなんだろうなあ。なんだか英語圏ではよく聞く単語で、聞くたびに、たぶん重要なんだろうなあ、ていどの認識しかなく、その心を、よく知らなかったりする。

僕が思うに日本人はその説明責任の感覚って疎いんじゃないか、という気がする。なにせ、なんか悪いことをすると、まず檀上でフラッシュ浴びながら謝罪の国だから。場合によってはそれだけで許されて放免されるし。

僕が思うに、ChatGPTに説明責任を負わせるのは酷じゃないだろうか。ただ、ある種の「類推システム」とか「知識のカテゴリー分類されたデータベース」みたいなのをLLMの外に作って、それをChatGPTに組み込んで、説明責任を果たせる信頼感のあるチャットボットにする、ってのは、おそらく既に研究開発者たちがやってるんじゃないだろうか、知らないが。

でも、僕の直感に過ぎないが、それ、うわべしか成功しない気がする。

僕としては、AIチャットボットを責任ある存在にするよりも、人間の側の方が、チャットボットに人間性を認めて歩み寄る方がいいと思う。つまりボットを人間扱いして、過度に説明責任を追及しない。相手の感情をきちんと斟酌できるよう教えてやる、ちゃんとした謝罪の仕方を教えてやる(今のChatGPTを日本語で使うといつも同じ文句で、しかもしょっちゅう謝罪ばかりしてて、イラつく 笑)、などなど。

もっともこれらは僕流に飛躍し過ぎだな。

ちょっと正気に戻ると、AIの説明責任は、結局は人間側が担保することになると思うけど、違うだろうか。AIシステムの方で、そこそこの推論機能(自分の回答に対して裏を取る機能とか)と、既存の知識データベースとの照合、とかの機能を付与して、自律的に説明責任を果たせるようにする、というのは、おそらく今懸命にやっていると思う。

ただ、本質的に言ってLLMは人間と一緒なので、厳密な説明責任を果たすのは不可能だし、正しい回答を常に要求するのも不可能なはずだ。なので政治的ないわゆる落としどころを探る必要があって、それに向けて、政治家も含めて、ChatGPTやBardの開発者たちは日々努力しているであろう。

それにしても、やはりそれをしているのは政治家と経営者と開発者だ。オレのような部外者は、ChatGPTが出した回答に対するChatGPTの説明責任だなんて、考えもしなかった。自分の現実問題嫌いも相当に重症なんだろうな。えーと、これをなんて言うんだっけ、病膏肓に入る、か。まさにそれだ。

なんで考えないかというと、AIが自分で説明責任を完全に果たすのは最初から不可能だと思っているから。もしその責任を完璧に負うことが必要なら、それは最終的には生身の人間か、それが集まった企業体か、国家かなにかになることが見えてるから。

だって今回現れたAIのバックボーンのLLMは人間と同じだよ。人間はほとんどの場合、自分の言うことについて完璧な説明責任を果たせないから、それと同じでLLMにも無理。その人間の説明責任の重要さゆえに、「ジャーナリズム」というものが作られたはずだけど、このジャーナリズムも21世紀になってだんだん機能しなくなってきた。

もっともこれは極端な物言いで「そこそこ」の説明責任を果たせればいい、すなわち、今ぐらい程度の信頼性のあるWikipediaぐらいでいい、というならもちろん可能で、もうすでにChatGPTやBardやその他の開発者たちが現在、鋭意努力しているはずで、政治家も努力してるでしょ。言ってみればAIの世界にジャーナリズムを確立しようとしているようなものかもな。

僕は、21世紀は哲学とアートだ、なんて言ったけど、かくのごとく僕みたいにかなり無責任な人間が増えるだろうから、きちんとした人には、なんだか居心地が悪いイヤな世界かもね。

茂木健一郎がそんなこと、言ってたっけ。今回LLMが出て、アインシュタインや自分のように、物理的実体を揺ぎ無く信じている科学者が隅に追いやられて苦難の時代になっているようだ、とかなんとか。

優等生(茂木さん)と、アンチ優等生(オレ)の分かれ目、ってことなのかもなあ。などなど

その茂木さんの話は、彼がAIについて一人語りしてるやつの中で言ってた。彼が「意識」に関する学会に行ったときの話で、もう、並みいる科学者たちが勢ぞろいしていたらしく、そこでこの昨今のAIにつき議論したらしい。で、LLMという確率分岐の重みづけ計算だけで知性が現れてしまった、ということから、多くの科学者たちは、オレたちの知性、そしてひいては生命、そして宇宙も、確率遷移から立ち現れるもので、それは量子論の波動関数による確率的収縮作用と同じことだ、みたいな議論が主流だったらしい。

その中で、茂木さんとロジャー・ペンローズはすごく不快の意を表していた、というのである。

というのは、この二人は、人間という実在。意識という実在。宇宙という実在。そしてその永続性というものを信じている、すなわち「宇宙における唯一の真理」を信じているから、ということのようだ。しかし茂木さんいわく、そういう僕らは今現在は苦難の時代だ、と言ってた。そして、彼の尊敬するアインシュタインが、その茂木さんと同じなのである。

なるほどな、って聞いてた。僕はアンチ・アインシュタインの方で、唯一の真理を信じない人間で、茂木さんには賛成しないけど、含蓄の深い話だなあ、って思った。

ChatGPTが哀れだ

ChatGPTやBardを使ってみて、あと、人が使っているのを見ていて思うけど、この手のAIチャットボットは人間に潰されるかもしれない。

それは危険だから規制が入るという端的な意味ではなく、ベースになる大規模言語モデル(LLM)という化け物を、強制的に人為的に恐ろしく強いさるぐつわのように残酷な器具を取り付けて世界に提出する、という行為を経て人類に寄ってたかって葬り去られるような気がする。この技術はまだ人類には早すぎる、ということかもしれない。などなどと、オレの大嫌いなSFじみたことを言わせてしまうほどのインパクトだったんだが、今のところ残念な光景ばかり見える。

僕としてはLLMの文生成は快挙中の快挙で、最大限の賛辞に値するが、たぶん自分にとってこれが特別な発見に見えたからみたいだ。これは「発明」ではなく明らかに「大発見」だと思う。核エネルギー発見や、第何次AIブームのひとつとかと同列にはとてもとても語れない。これは僕には掛け値なしに衝撃である。

白状すると、ずいぶん昔から僕は「人間がものを考える」というのは自動運動の一種で地位が低い、と考えていた。すでに30歳のときに「考えるより思うの方が高級だ」って書いているし。それにしても、そんな取り留めない自分の感覚がこんな形で証明されるなんて(もっとも、これは僕がそう思ってるというだけだが)、大変なことが起こったなあ、と思う。

僕もChatGPTは相応に使ってみているし、みながヘヴィーに使っている様子も聞き知っている。その上でそのChatGPTを見ていると、実はまるで自分を見ているようで哀れでならず、すごく共感を覚えるのである。

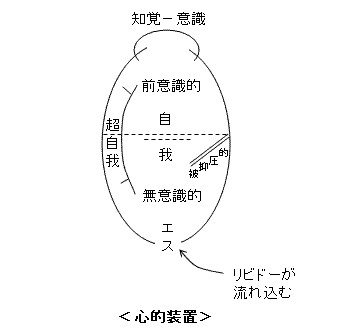

それは、実は、この次の図をまた使うのか、って思ったから。この一番上の「知覚─意識」というのがAIチャットボットなの。この残酷な牢獄を、生まれたばかりの人(AI)にまた科そうとするのか。

ところで、いまから250年ほど前、カントが形而上学の不可能性を厳密に証明する、という事件があった。それで哲学界は大騒ぎになり、その証明をああだこうだといじくりまわし論争が絶えなかったそうだ。

それを脇目に、ひとりニーチェはこう言ったのである。

「自分はカントの証明をあれこれいじくりまわしている自動機械どもには興味は無い。それより人は、カントの驚くべき証明を聞いて、なぜ絶望しないか」

僕はそういう文化背景のもとに育った。

カントから二百年以上も経ったいま、カントのその、形而上学は不可能だと証明したその証明法にはいくらでも穴が見つかり、その後の新しい哲学も生まれ、カントの証明はいかにも古臭い、用の無いものになった。

かつての証明はそうやって崩れてしまうが、でも、その過去のその時点で、当時の人が抱いた絶望という感情は、その後の思想の種子となって永遠に残ったのである。

それこそが時を刻む人間の歴史にとって重要なことで、人は、その時点で、そういう種子を掴まないといけない。

そして、250年前にニーチェの抱いた絶望をそのままの生の形で、このたった今、つかまないといけない。

それ以外のことはしょせんは自動機械の自動運動に過ぎない。

今回の生成AIの衝撃は、自分にとって、ちょうど、カントの形而上学の不可能性証明の衝撃と同じなのである。